O FIM DA ERA "HAYSTACK": POR QUE SEU AGENTE ESTÁ FALHANDO COM CONTEXTOS LONGOS

Descrição do post.

2/10/20262 min ler

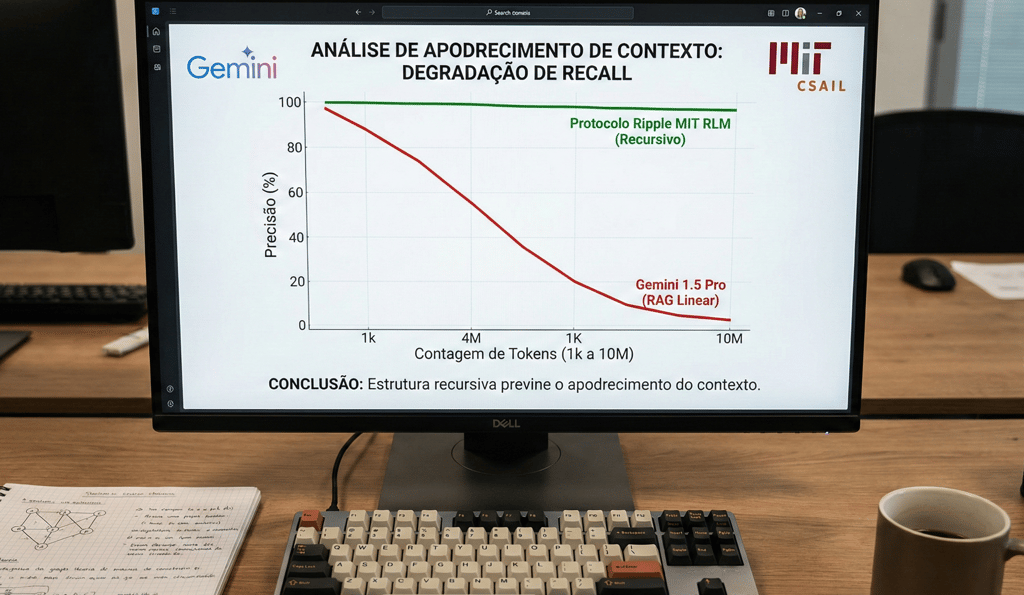

A indústria de IA vendeu uma mentira: a de que "janelas de contexto gigantes" resolveriam a inteligência. O que estamos vendo em campo — e o que o MIT acaba de dissecar em seu paper sobre RLMs (Recursive Language Models) — é o fenômeno da Apodrecimento de Contexto (Context Rot).

Se você está construindo infraestrutura agêntica hoje, pare de empilhar tokens e comece a construir grafos.

1. A Patologia do "Context Rot"

Não se trata apenas de caber 1M ou 2M de tokens (como no Gemini 1.5 Pro). O problema é a complexidade da tarefa. Em documentos com alta autorreferenciação — como contratos de fusão (M&A) ou bases de código legadas — o modelo se perde em "saltos" (multihop reasoning).

O diagnóstico é brutal: Inserir mais contexto em um modelo sem estrutura de busca inteligente reduz a confiabilidade. O sinal é enterrado pelo ruído.

2. O Protocolo RLM: Código sobre Texto

O paper do MIT propõe o Ripple (Read-Evaluate-Print-Loop). Em vez de ler o documento como um livro, o agente opera sobre ele como um objeto de dados.

https://arxiv.org/pdf/2512.24601

Recursão: O modelo principal delega sub-tarefas para instâncias menores, focando em fatias específicas.

Grafos de Dependência: A missão não é "resumir", mas mapear como a Cláusula A afeta o Parágrafo B. Se você trata código ou lei como narrativa linear, você já perdeu.

3. Realidade do Fórum: Gemini vs. GPT

A "promessa de marketing" do Google com o Gemini 1.5 Pro é sua janela massiva, mas no r/LocalLLaMA e r/MachineLearning, a realidade é mista:

O "Glitch" da Preguiça: Engenheiros reportam que o Gemini 1.5 Pro ainda sofre de "laziness" em tarefas de codificação complexas se comparado ao GPT-4o ou Claude 3.5 Sonnet.

O Raciocínio de Sénior: Enquanto o Gemini olha para o repositório inteiro como um "estagiário", o GPT-4o olha para 1/4 dele com olhos de "arquiteto sênior".

4. O Perigo da Recursão Infinita

A implementação de RLMs não é um "almoço grátis". Sem guardrails, o sistema entra em loops recursivos que podem incinerar seu orçamento de API em minutos. O segredo está na asincronicidade controlada e em manter a recursão em apenas uma camada de profundidade.